Le test de la « voix familière » est mort. Maintenant que l’IA peut imiter un PDG en quelques secondes, les entreprises doivent traiter chaque appel non authentifié comme un risque potentiel de 25 millions de dollars.

La technologie Deepfake a franchi un seuil critique. Ce qui était impossible il y a 10 ans et nécessitait une expertise spécifique il y a seulement quelques années est désormais bon marché et accessible. Pire encore, c’est désormais suffisant pour tromper un large éventail d’employés et de dirigeants. En fait, une enquête Gartner de 2025 a révélé que 43 % des responsables de la cybersécurité ont été confrontés à au moins un deepfake audio et 37 % à un deepfake vidéo au cours de l’année écoulée.

Ces découvertes reflètent ce que nous voyons dans la nature. Les deepfakes ne constituent plus un risque futur hypothétique ; ils apparaissent dans les flux de travail, décisions et incidents réels. Relever ce défi sophistiqué et évolutif nécessite une vérification rapide, une coordination interfonctionnelle et une communication claire pour limiter l’impact des médias synthétiques.

L’effondrement des heuristiques

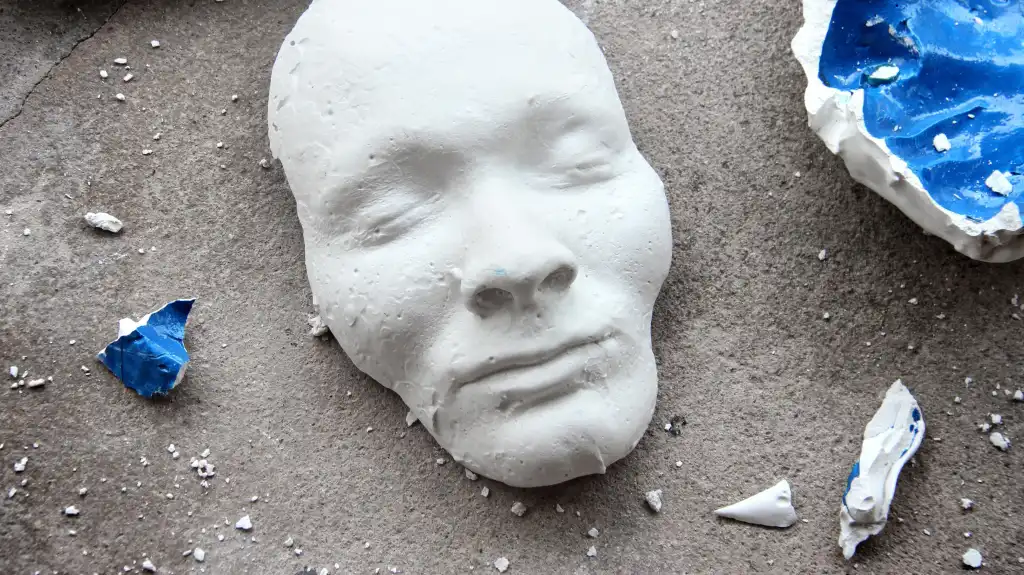

Les humains ont tendance à s’appuyer sur des raccourcis mentaux, ou heuristiques, pour juger de ce qui est réel. Historiquement, il suffisait de faire confiance à un visage ou à une voix familière pour se sentir en confiance. Les premiers deepfakes ont commencé à tester ces instincts, mais ils étaient souvent gâchés par des défauts révélateurs, tels que des clignements inhabituels, des doigts mutilés ou un texte flou.

Malheureusement, cette approche éprouvée pour distinguer les faits de la fiction n’est plus fiable. Les indices évidents qui rendaient les deepfakes plus faciles à repérer ont été éliminés par la dernière génération de modèles d’IA génératifs, tels que Nano Banana Pro. En conséquence, on ne peut pas faire confiance aux heuristiques sur lesquelles les humains se sont historiquement appuyés de manière isolée.

Les deepfakes comme outils de fraude financière

Les deepfakes sont rapidement devenus un puissant catalyseur de fraude financière. Cela est dû en grande partie au fait que la plupart des canaux de communication professionnels, comme les appels vidéo et vocaux, ne sont pas authentifiés. Un seul appel audio ou vidéo convaincant, apparemment émanant d’un cadre de confiance, peut contourner les contrôles établis en quelques minutes. Dans ces scénarios, les employés suivent souvent les instructions ou approuvent des transferts de fonds importants, croyant qu’ils répondent à des demandes légitimes.

Un exemple bien connu de ce risque s’est produit chez Arup, où le directeur financier de l’entreprise et d’autres participants à un appel vidéo ont été simulés de manière convaincante à l’aide de deepfakes générés par l’IA, et où un employé a transféré environ 25 millions de dollars.

Tant que la double authentification robuste pour les appels téléphoniques ne sera pas standardisée, les organisations resteront exposées à toute personne capable d’imiter de manière convaincante un directeur financier ou un PDG.

Les deepfakes comme armes de réputation

La fraude financière reste une préoccupation majeure avec les deepfakes, mais ils sont de plus en plus utilisés comme des armes de réputation, conçues pour éroder la confiance des investisseurs, des clients et des partenaires commerciaux. Les attaquants n’ont besoin que d’un bref extrait, souvent d’à peine 20 secondes, pour se faire passer pour un dirigeant et mettre à mal des années de réputation et de confiance bâtie auprès des principales parties prenantes. Au-delà du C-cuite, toute personne ayant une empreinte numérique, depuis une apparition dans un podcast jusqu’à un court clip sur les réseaux sociaux, pourrait devenir une cible.

Des cas récents montrent à quelle vitesse ces faux récits peuvent dégénérer et causer de réels dégâts :

- Déstabilisation du marché: En janvier 2026, la Bourse de Bombay a été contrainte d’émettre un avertissement urgent après la diffusion en ligne de vidéos deepfakes de son PDG, faisant la promotion de conseils boursiers frauduleux et de promesses de « bénéfices supranormaux ».

- Perturbation publique: Après un tremblement de terre en décembre 2025 au Royaume-Uni, une image synthétique d’un pont effondré est devenue virale, entraînant des annulations de trains.

- Sabotage interne: Dans une affaire privée, un ancien employé a créé des deepfakes de dirigeants d’entreprise tenant des propos incendiaires et les a distribués directement à des partenaires commerciaux, dans l’intention de nuire à leur réputation.

Chacun de ces incidents a contraint les organisations concernées à passer en mode crise. La propagation rapide des deepfakes sur les plateformes numériques signifie que les faux contenus circulent souvent plus rapidement que les équipes ne peuvent enquêter ou y répondre. Au moment où la vérité éclatera, les dommages causés aux relations et à la réputation seront peut-être déjà causés.

Renforcer la résilience contre les deepfakes

Les incidents Deepfake diffèrent des autres cyberattaques. Même s’ils ne provoquent pas de pertes financières immédiates, ils se révèlent souvent publiquement, se propagent plus rapidement que les enquêtes ne peuvent suivre le rythme et exploitent la confiance humaine à grande échelle. Pour la plupart des organisations, gérer l’incertitude généralisée et les atteintes à la réputation résultant d’un incident de deepfake dépasse les capacités des équipes internes, en particulier lorsque la confiance du public est en jeu.

Relever ce défi nécessite plus que des contrôles techniques. Les chefs d’entreprise reconnaissent de plus en plus l’importance de pouvoir répondre à ces menaces de manière rapide et décisive. Une réponse efficace dépend désormais de capacités permettant aux organisations de vérifier le contenu, de limiter sa propagation et de communiquer avec les parties prenantes de manière rapide et crédible. En pratique, cela comprend :

- Analyse technique: Examen médico-légal par des experts du contenu audio et vidéo pour déterminer si le contenu a été manipulé et générer des preuves médico-légales pour les parties prenantes.

- Assistance juridique: La capacité d’agir une fois qu’un contenu préjudiciable a été identifié, notamment en coordonnant les demandes de retrait en travaillant avec des experts juridiques pour soutenir la suppression des contenus malveillants ou diffamatoires des plateformes en ligne.

- Communication claire: Soutien aux relations publiques et à la communication pour aider les organisations à élaborer des messages efficaces destinés aux employés, aux investisseurs et aux clients lors d’un incident évoluant rapidement.

La voie à suivre : l’authentification comme état final

À long terme, la lutte contre les deepfakes nécessitera probablement une large adoption de normes d’authentification et de filigrane, comme la façon dont les navigateurs Web affichent une icône de verrouillage pour signaler une connexion sécurisée et authentifiée. Par exemple, les organisations pourraient bientôt intégrer des filigranes dans leurs communications officielles, telles que les communiqués de presse, les interviews et les appels à résultats.

Pourtant, les filigranes ne résoudront pas tous les problèmes. Certains contenus authentiques, comme les révélations des lanceurs d’alerte, circuleront inévitablement sans marques officielles. Les attaquants pourront toujours simuler ce type de contenu, nous laissant dans un jeu continuel du chat et de la souris, dans lequel les journalistes et les experts légistes doivent s’appuyer sur des sources alternatives et des outils avancés pour vérifier les documents. Établir la confiance dans les médias numériques restera un processus continu, à mesure que les attaquants et les défenseurs s’adapteront.

Pour les professionnels du monde des affaires et du risque, la conclusion est claire : la véritable résilience ne dépend plus des heuristiques et de la confiance dans ce que nous voyons ou entendons. Cela dépend de la rapidité avec laquelle les organisations peuvent vérifier la réalité, coordonner une réponse avec le soutien et les ressources d’experts et rétablir la confiance avant que la désinformation ne devienne le discours dominant.

Cet article est publié dans le cadre du Foundry Expert Contributor Network.

Voulez-vous nous rejoindre ?